从视频到动画的不成对运动风格转换

从视频到动画的不成对运动风格转换

# 从视频到动画的不成对运动风格转换

# Unpaired Motion Style Transfer from Video to Animation

# 概览视频

# 摘要与方法

我们提出了一种新颖的数据驱动的运动风格迁移框架,它从带有风格标签的不成对的运动集合中学习,并能够迁移训练期间未观察到的运动风格。此外,我们的框架能够直接从视频中提取运动风格,绕过 3D 重建——这种能力使人们能够将风格示例集扩展到远远超出 MoCap 系统捕获的运动范围。

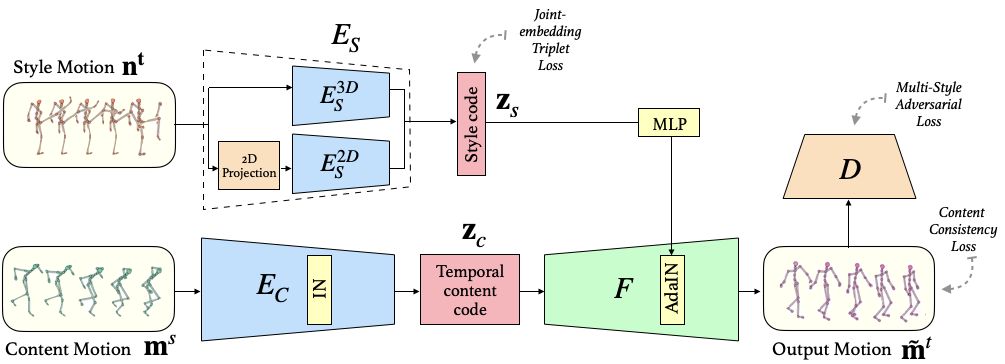

我们的风格转移网络将运动编码为两个潜在代码,分别用于内容和风格,每个潜在代码在解码(合成)过程中发挥不同的作用。虽然内容代码通过多个时间卷积层解码为输出运动,但风格代码通过时间不变自适应实例归一化 (AdaIN) 修改深层特征。

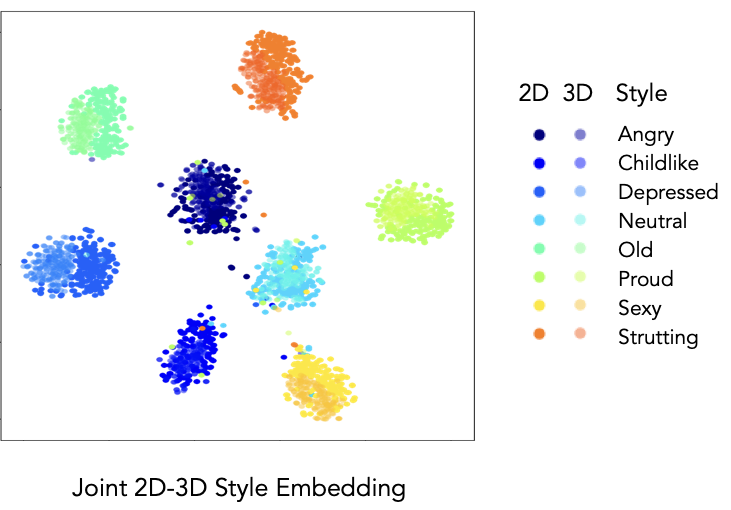

虽然内容代码是根据 3D 关节旋转进行编码的,但我们从 3D 或 2D 关节位置学习通用的样式嵌入,从而能够从视频中提取样式。

# 运动风格迁移

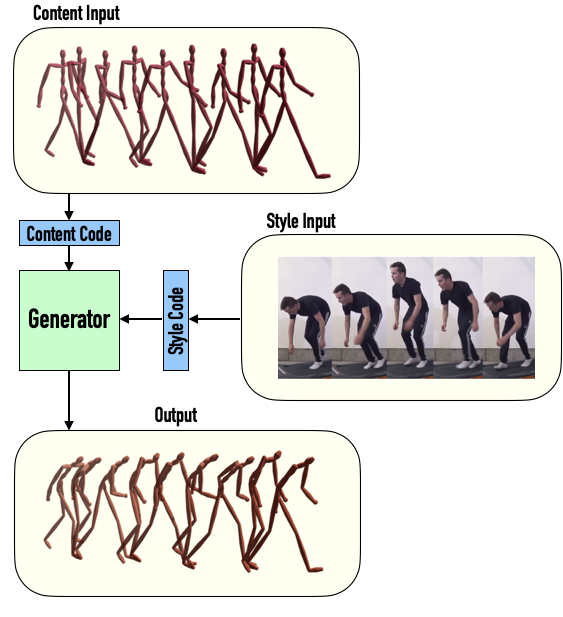

给定内容和风格输入动作,我们的网络可以合成新颖的动作,展示一个输入的内容和另一个输入的风格。

# 从视频迁移运动风格

我们的网络可以从视频中提取的 2D 关键点推断风格,并将其应用于 3D 动画。

# 运动风格迁移 - 比较

我们的方法与 Holden 等人的方法的定性比较。 [2016]。

[ 内容输入样式输入 Holden 等人。 2016] 我们的

# 风格插值

我们学习的连续样式代码空间可用于在样式之间进行插值。风格插值可以通过在风格代码之间进行线性插值来实现,然后通过我们的解码器对结果进行解码。

# 书目词典

@article{aberman2020unpaired,

author = {Aberman, Kfir and Weng, Yijia and Lischinski, Dani and Cohen-Or, Daniel and Chen, Baoquan},

title = {Unpaired Motion Style Transfer from Video to Animation},

journal = {ACM Transactions on Graphics (TOG)},

volume = {39},

number = {4},

pages = {64},

year = {2020},

publisher = {ACM}

}

1

2

3

4

5

6

7

8

9

10

2

3

4

5

6

7

8

9

10